アビブ・オバディア氏は2016年半ばに、インターネットで根本的に誤った事態が起きていると気付いた。あまりにも異様だと感じた同氏は、仕事を辞めて警鐘を鳴らすことにした。そして、2016年11月の米国大統領選挙を数週間後に控えたころ、サンフランシスコのベイエリアで活動する科学技術者たちの前で自分の懸念を表明し、差し迫っている偽情報による危機を「情報の終焉(Infocalypse)」と題したプレゼンテーションで警告した。ちなみに「Infocalypse」とは、「information(情報)」と「apocalypse(世界の終わり)」を組み合わせた造語である。

オバディア氏は、ウェブ技術とそれを取り巻く形で開発された情報エコシステムについて、酷く不健全な状態にあると主張した。インターネットで利用されている巨大プラットフォームの動きを方向付ける仕組みは、誤解を招いたり、対立させたり、もしくはその両方をあおる情報に高い評価を与えるよう調整されている。FacebookやTwitter、Googleのようなプラットフォームは、情報そのものの質よりも、クリック数、シェア数、広告、収益を高く評価する。オバディア氏は、こうしたすべてが得体の知れない悪質なものを作りつつある、との考えをぬぐい去れずにいた。習慣性と毒性の高い偽情報に関して、取り返しのつかない一線を越える状況ではないか、というのだ。オバディア氏のプレゼンは、こうした巨大プラットフォーム運営企業の社員からほとんど無視されたが、Facebookからの一部参加者は、後にFacebookの「ニュースフィード」機能を正常化させる取り組みを推進することになった。

「その当時、制御できずフラフラ疾走する車に乗っているような気分だった。それなのに、誰もが『よい調子だ』と言うどころか、コントロール不能な車の存在にすら気付いていなかったのだ」(オバディア氏)

政治家、ジャーナリスト、大企業のCEOも含め多くの人が数カ月後にやっと認識した危機を、オバディア氏は早い段階で察知していた。プラットフォーム化され、アルゴリズム的に最適化された我々の世界は、プロパガンダ、偽情報、外国政府の作る悪質な狙いを定めた宣伝に対し、極めて弱い。そのため、人間のコミュニケーションで土台となる、事実に対する信頼性が、脅かされている。

ただし、オバディア氏がこれから訪れると予測している状況は、震え上がるほど恐ろしい。

オバディア氏はある1月の午後、「根拠なく騒ぎ立てることも、時には役立つ。この件に関しては、扇動者になるべき」と述べた。そして、これからの20年間に経験するフェイクニュース、人工知能(AI)を悪用した偽情報による作戦行動、プロパガンダについて、心底から不安になる予測の概要を、落ち着いて説明し始めた。「我々は、ほとんどの人が想像する以上に酷くねじ曲げられている。1年半前にも徹底的に騙されたが、今はそれ以上に歪曲されている。そして、どれだけ先の未来を考えるかによって変わるが、状況は悪くなる一方だ」(同氏)

オバディア氏の描く未来は、現実を改竄する目的で人間の知覚を操作してしまう、各種技術を組み合わせた使いやすく完成度の高いツールで溢れかえる。こうしたツールは、「現実に対する無関心(reality apathy)」、狙いを絞り込んだフィッシング攻撃である「自動レーザー・フィッシング(automated laser phishing)」、「人間操り人形(human puppets)」と呼ばれる行為に使われる。

マサチューセッツ工科大学(MIT)で工学を学び、Quoraなどの技術系企業で働いていたオバディア氏が2016年にすべて投げ捨て、強大な技術で引き起こされる情報危機と呼ぶ状況を防ごうと立ち上がったのには、こうした理由がある。そんな同氏は、自身の気付きを「いつの日か、クリックするだけで済むようになる」と表現した。注目度を評価対象とする現在の「関心経済(attention economy)」が悪用され、関心経済を下支えするFacebookなどのプラットフォームが真実の歪曲に悪用される状況だと、その動きを止めるバランス機構など存在しない。同氏には、これがハッキリ見えたのだ。「こうしたシステムが制御不能になったら、コントロールするすべなどなく、急速に悪化していく、と認識した」(同氏)

「1年半前にも徹底的に騙されたが、今はそれ以上に歪曲されている」

オバディア氏と、緩やかに同氏と連携している研究者や教育関係者の仲間は現在、未来が憂慮すべきディストピアになると考え、不安視する。同氏らが、最近登場し始めた技術を念頭に置いて戦争ゲーム風の厄災シナリオを検討したところ、結果はまさに気が滅入るようなものになった。

現在のオバディア氏は、ミシガン大学のソーシャル・メディア信頼性センターでチーフ科学技術者を務め、コロンビア大学トウ・センター・フォー・デジタルジャーナリズムのナイト・ニュース・イノベーション・フェローでもある。そんな同氏にとって、ロシアの関与したFacebook広告とTwitterボットに対する衝撃と今も続く不安など、この先で待ち構えている強大な脅威に比べ、大したものではない。現実を強調して歪めることに利用可能な技術の進歩は早く、我々が理解し、コントロールしたり影響を弱めたりする能力の向上速度を上回っている。代償は大きく、考えられる結末は、選挙に対する外国から受ける干渉よりも悲惨だ。文明的な社会の中核が揺るがされたり、転覆されたりして、「情報の終焉」に至る。そしてオバディア氏は、この結末を迎える可能性が2016年の危機と同じくらい高く、余計に酷い、と話す。

より酷くなるのは、高まる一方であるコンピュータの処理能力のせいだ。事実とフィクションの境界を曖昧にしてしまうAIおよび機械学習(マシンラーニング)技術の高度化も、悪化の原因である。さらに、こうした要素は、オバディア氏が「実際に起きたかどうか関係なく、誰もが何らかの事態を事実であるかのように」捏造できてしまうと考える未来を現実化し、結末を悪化させる。

「実際に起きたかどうか関係なく、誰もが何らかの事態を事実であるかのように捏造できてしまう。この世界は一体どうなるのだろうか」

標的を絞り込んだ偽情報による作戦行動が外国からの援助で実行されることなど、実際に起きてしまったと気付くまで、近い将来の脅威などと思いもしなかった。それと同様のことだ。オバディア氏は、AI、機械学習、拡張現実(AR)をベースとする急速に開発の進むツールが悪者に乗っ取られ、人間の模倣と情報戦争の勃発に使われる、と警告している。

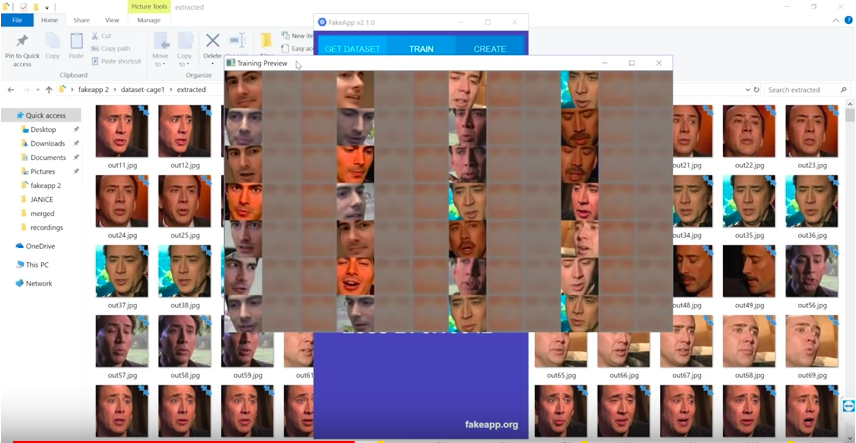

そして、予想される「情報の終焉」の訪れは、我々の想像よりも早い。すでに現時点で利用可能な音声およびビデオの改変ツールは、第二次世界大戦中に米国で進められた原爆開発プロジェクト「マンハッタン計画」のフェイクニュース版といった様相を呈し始めている。インターネットの怪しげな片隅では少し前から、アダルトビデオ出演者の体に著名人や任意の誰かの顔を合成して作るポルノビデオ「フェイクポルノ」が作られている。このようなコンテンツも、機械学習アルゴリズムとオープンソース・ソフトウェアを使えば簡単に違和感なくできてしまうのだ。スタンフォード大学の参加した研究チームは、あらかじめ録画しておいた人物Aの顔をとらえたビデオと、リアルタイムにスキャンする別人物Bの表情の変化を合成し、ビデオ内でAの表情をBの表情に合わせて変える、というプログラムを開発した。ワシントン大学では、同様の技術として、「何らかの音声データを入力し、ある人物がその音声データの内容をあたかも話しているかのようなビデオを生成する」プログラムが作られた。これらのプログラムを使うと、テレビ番組で話す世界のリーダーたちのビデオを加工し、実際には発言していないことを話す偽映像が捏造できる。

こうしたツールが広まり、誰でも使える状態になりつつあるため、オバディア氏は最悪のシナリオとして極端に不安定な状況があり得る、と指摘している。

「外交操作」と呼ばれる活動では、地政学的な影響を及ぼす目的で、「ある出来事が実際に起きたと信じ込ませる」ために高度な技術が悪用される。ある種の機械学習アルゴリズムは、特定の機能を実行可能にするため、アルゴリズムそのものが膨大のデータを分析する。例えば、そんなアルゴリズムが米国のドナルド・トランプ大統領や北朝鮮の独裁者である金正恩氏の数百時間に及ぶビデオを処理すると、ほぼ完璧で本物か偽物かほとんど見分けられない、核戦争や生物兵器戦争の宣戦を布告する音声やビデオが出力できる。「出力結果は完璧でなくてよい。敵に対して、脊髄反射的に無謀な仕返しをする出来事が発生したと信じ込ませられる出来栄えで十分だ」(オバディア氏)

「完璧でなくてよい。ある程度の出来栄えで十分だ」

オバディア氏が「政治形態シミュレーション」と称する別のシナリオは、政治的な目的で運用されるボットネットと、(市民から自然発生的に起きる本物の「草の根運動」でなく、背後で暗躍する組織のある「偽物の草の根運動」である)「人工芝運動」が組み合わさるディストピアだ。同氏は、草の根運動と人工芝運動の区別が困難になるため、AIで動くボットに対する信頼性が高まり、政治家や監督機関への影響が実在する人間並みに強まるだろう、と考える。こうした運動が繰り返されると世間の議論が操作され、アルゴリズムで生成された、つい信じてしまう感銘するような嘆願が議会に押し寄せる状況へと、近い将来に陥りかねない。同じように議員のメール受信ボックスも、さまざまな文章、音声、ソーシャルメディアのプロファイルを寄せ集めてコンテンツ生成する機械学習プログラムによって、実在しない有権者からの偽メッセージであふれるだろう。

これに続き、オバディア氏によるとセキュリティ研究者のあいだで言及され始めているという、自動レーザー・フィッシング攻撃が実行される。このフィッシング攻撃は、基本的にはAIが標的とした人物のソーシャル・メディア利用データを調べ上げ、知人から届いたと思い込むであろうメッセージを偽造する手口だ。オバディア氏は、これで状況が一変するとみている。レーザー・フィッシングのような方法を使えば、公に入手可能だデータをベースにして、特定人物の偽物も作り出せるのだ。

「従来だと、声の真似をする人や、信用される偽の会話を用意しなければならなかった。自動レーザー・フィッシングなら、オープンソース・ソフトウェアを使ってボタン1つ押すだけで、同じことができてしまう。これがこの手法の新しいところだ。とても簡単なので、誰でも実行できる。そして、状況が完全に変わる」(オバディア氏)

オバディア氏は、クリックを誘う分かりにくいリンクだけでなく、話の流れに合った個人的内容の書かれたフィッシング・メッセージ、を例に挙げた。「単なるメールでなく、しばらく前から連絡を心待ちにしている友人からのメールが届く。さらに、いとも簡単に偽造できてしまい、受け取った人は完全に騙される。何らかの目的で騙そうとするスパムメールが、実在する知人からのメールと見た目で区別できなくなれば、最終的に『もう受信ボックスを無視することにした』と言うしかなくなる」(同氏)

こうした事態が、オバディア氏の言う「現実に対する無関心」という状況を招く。絶え間なく流れてくる偽情報に包囲されると、ただ単に諦め始めてしまう。同氏は、情報が乏しいために不正確であると判断されてしまう地域だと、このような状況が当たり前だと指摘した。ただし、我々の暮らす先進地域にも無関心が広まる、という点が大きく異なるという。そして、悪い結果になると恐れる。「人々はニュースに関心を持たなくなり、民主主義の機能に欠かせない、基本的な情報量が揺るがされてしまう」(同氏)

オバディア氏だけでなく、ほかの研究者も、レーザー・フィッシングが間違いなく広まると見ている。「確実にやって来る脅威であり、そのうえ状況は悪化する。現時点で有効な対策は存在しないと思う。広まり始めたら、止めるのにはインターネット規模のインフラが必要だ」(同氏)

それだけでない。オバディア氏が「あり得ない」と称する、長期的な別の悪夢的シナリオもある。ただ同氏は、それほどあり得ない話でもないので、検討対象のシナリオから除外したくないとしている。しかも、このシナリオは恐ろしい。例えば「人間操り人形」は、ソーシャル・メディア上に存在するマーケットプレイスのブラックマーケット版であり、ボットでなく生身の人間が活動するのだ。「本質的には、これは国境を越える成熟した未来のマーケットで、そこでは好きなように操れる人間が供給される」(同氏)

オバディア氏の予感は、これまでも我々の民主主義が、初歩的かつ単純な偽情報による手口でやすやすと操作されてきたことを考えると、とりわけ恐ろしく思える。詐欺、ごまかし、まやかしなど、目新しくない。しかも、より巧妙になり、見破ることがはるかに難しくなった。そのうえ、今の時点で知られていないどころか、ほぼ予測不可能な、ほかの手口と組み合わせて使われる。

AIと機械学習の進歩に注目している人なら、こうした考えを誇張だと感じない。今の時点でも、半導体メーカーのNVIDIAが開発しているソフトウェアは、膨大な数の画像を処理することで、本物にしか見えない物、人、そして景色のリアルな画像を生成できてしまう。また、Adobe Systemsも先ごろ、写真編集ソフトウェア「Photoshop」の音声版と呼ぶべきツール「Voco」と、数クリックするだけでビデオから物や人物までも自然に消せるツール「Cloak」を、試験的にリリースした。

技術があまりにも優れていて、開発者本人をも慌てさせることがある。Googleのニューラルネットワーク開発プロジェクト「Google Brain」で研究していた科学者のイアン・グッドフェロー氏は、AIがニュースの消費を100年ほど過去へ逆戻りさせかねない、と警告した。ちなみに同氏は、人間の手助けなしに自ら学習していけるニューラルネットワークである「敵対的生成ネットワーク(GAN)」の開発に貢献した人物である。同氏は、2017年11月に開催されたMIT Technology Reviewのカンファレンスで参加者に対し、GANは「想像力と内省力」の両方を備え、「人間の手助けに頼ることなく、開発者がどれだけうまく作ったかを評価する能力を持っている」と話した。さらに、GANベースのマシンが持つ創造性に関する可能性は果てしないものの、その能力を我々の情報消費方法に対して発揮させると、GANの革新性は「我々の世代がこれまで開け放っていたドアの一部を閉める」だろう、とも述べた。

そうした観点で見ると、オバディア氏が描く政治形態シミュレーションのようなシナリオは、確かに実現してしまいそうに思える。2017年の夏、「ネット中立性の原則撤廃に反対する活動を拡大」させる目的で、100万個以上もの偽ボット・アカウントからの投稿が米連邦通信委員会(FCC)のパブリックコメント受付窓口に殺到した。研究者たちは、自動生成されたコメントが真っ当なコメントを覆い隠し、完全に開かれたコメント受付システムの信頼性を揺るがしてしまった、と結論付けた。自動生成コメントのなかには、人間が書いたもののように見せるため、自然言語処理が施されているものもあった。オバディア氏は、このFCCの事例や、大統領選絡みのロシア疑惑に関する米連邦捜査局(FBI)の外国諜報監視法(FISA)メモを公開させようとしてボットが投入された「#releasethememo」キャンペーンについて、混乱を招く目的で将来実行されるであろう活動の初歩的なもの、とみなした。「状況は酷く悪化する一方の可能性がある」(同氏)

「深刻な影響を与える目的でも、この技術を証明する偽ビデオを作る必要などない。そうした技術が存在すると指摘するだけで、ある事態が真実であることを示す真正性に対して、異議を唱えられる」

公的な発言の信頼性と正当性を損なうこの種の行為は、この先に出会う脅威のなかでも、特に悪質で憂慮すべきものであると考えておそらく間違いない。コンピュータを使ったプロパガンダについて研究しているレニー・ディレスタ氏は、「AIだろうと、Amazon.comに対する操作ハックだろうと、偽の政治的な積極行動主義だろうと、行為を支える技術は信用をますます毀損(きそん)させる。ビデオやある問題に関する主張に対して、本物かどうかという疑いを投げかけることが可能になる」と述べた。一例として挙げたのは、テレビ番組「アクセス・ハリウッド」で流された録音テープの声について、トランプ大統領が自分のものでないと否定した件だ。トランプ大統領は、専門家から得た「デジタル技術で偽造可能」という意見を根拠にしていた。「深刻な影響を与える目的でも、この技術を証明する偽ビデオを作る必要などない。そうした技術が存在すると指摘するだけで、ある事態が真実であることを示す真正性に対して、異議を唱えられる」(ディレスタ氏)

オバマ政権のアドバイザーを何年も兼任し、現在はトロール(荒らし)の偽情報キャンペーンに対抗する上院情報委員会のメンバーであるディレスタ氏のほか、同氏のような研究者および技術者たちや、ディレスタ氏と独立して活動してるオバディア氏は、こうした懸念から、将来の脅威について多く語るようになった。ニューヨーク市の企業と大学による共同研究を支援しているNYC Media Labが2018年2月第2週、技術者と研究者を集めて「未来のニュースと技術に関する最悪のシナリオを検討する」イベントを6月に開催すると発表した。「フェイクニュース・ホラーショー」と名付けられたこのイベントは、「恐ろしいプロパガンダ用ツールに対しても科学は平等である。実在するツールもあれば、想像に過ぎないツールもあるが、いずれも妥当な技術にもとづいている」としている。

NYC Media Labでエクゼクティブ・ディレクターを務めるジャスティン・ヘンドリックス氏は、「プロパガンダをもてあそぶ人々が、非常にリアルで、本物の写真に見えるシミュレーションの製作で財を成してしまう。2年後か3年後か4年後には、こうした層への対策が必要になるだろう」とBuzzFeed Newsに話した。「このようなシミュレーションは製作者の狙い通り機能し、メディアから提供されるあらゆる種類のコンテンツは事実にもとづかないと疑われるはずなので、状況はとても困難だ。目立つ偽情報がいくつかあれば、真実など1つもない、と世間に信じ込ませられる」(同氏)

偽情報の効果は、かつて否定的にみられていた。例えば、FacebookのCEO、マーク・ザッカーバーグ氏は、Facebookに掲載されたフェイクニュースが2016年の米大統領選で決定的な効果を発揮したとの見解を「クレイジーだ」と評した。しかし、今やこの発言の評判は悪い。そうした状況を思うと、オバディア氏などの研究者たちが踏み出す第一歩は、とても恐ろしい。事実を歪めてしまう情報の終焉が訪れそう、というだけでなく、目前に迫っていることを、多くの人々に加え、政治家、大学の技術者、技術系企業にも納得させなければならないのだ。

「目立つ偽情報がいくつかあれば、真実などひとつもない、と世間に信じ込ませられる」

情報戦争の調査を任されたことで知られる、米国連邦政府組織のある上級職員は、BuzzFeed Newsに対して、「オバディア氏などの描くようなシナリオに備えている政府組織がどれだけ存在するのか、自分ですら定かでない」と話した。「我々の状況は、1年前より不利になっている」と述べ、現在の対策があまりに貧弱だと指摘した。「私は啓発という意識でとらえているのだが、これは真実の探求に尽きる。目前で繰り広げられていることは、ポスト真実社会を作ろうとしている敵からの啓発に対する攻撃であり、憲法などの啓発文書に対する攻撃だ。そして、フェイクニュースのような行為は、現在の文明社会を根底から揺るがす直接的な脅威である」(その上級職員)

これは恐ろしい考えだ。この種の予想はとても扱いにくいので、余計に恐ろしい。コンピュータによるプロパガンダは、量的な問題でなく、はるかに質的なものだ。例えば、気象学者は、気温上昇の事実を示す明確なデータを出せる。ところが、まだ完成していない技術によって将来もたらされる影響については、予測に必要な信頼性の高いモデルを構築することなど、ほぼ不可能である。

政府職員などの技術者にとって、これから実行していける活動は、用心するよう呼びかけ、構築されるツールの道徳面および倫理面をよく考えることだけだ。その際、生み出してしまったフランケンシュタインのような怪物が目覚め、こちらに向かって「自分の行動がもたらす結果をきちんと考えていたのか?」と問いただす、という状況になるのを避けよう。

オバディア氏はBuzzFeed Newsに対し、「フリーソフトウェアとオープンソースの文化に育まれた自分にとって、活動目的は技術の歩みを止めさせることではない。技術が人間に役立つよう、確実にバランスをとらせたいのだ。そのため、ただ『こういう事態が起きようとしている』と叫ぶのでなく、『深刻に受け止めて、影響を考察しよう』と話している。私の述べていることは、『そうならないだろう、と信頼していこう』ということだ」と語った。

ほとんど励みにならない宣言である。オバディア氏も、やや楽観的だと認めている。コンピュータを使ったプロパガンダという分野への関心は以前よりも高まり、かつて脅威を深刻にとらえることに鈍かった人たちも、警告を以前より受け入れるようになった。「当初は冷ややかな反応ばかりで、耳を傾ける人は限られた。ところが、この数カ月で、見通しが本当に明るくなってきた。行き過ぎを抑えてバランスを取ろうとするある種の活動が、きちんとした形で動き始めている」(オバディア氏)。同時に、解決策も見つかってきた。画像と音声に対する暗号検証といった技術を使えば、本物と改変されたものとの識別が可能になる。

それでもオバディア氏らは、これから数年間は不安定になるだろう、と警告し続ける。同氏は、改善していく可能性があると考えつつも、Facebookなどのプラットフォームが、注目されるとして、クリック数稼ぎ目的のクリックバイト的かつ低品質なコンテンツを評価するため、今後も誤った扇情主義者たちの好きなようにコントロールされる、と感じている。「全体的に見て難問であるし、コンテンツの拡散などを加速させるFacebookのようなシステムと組み合わさると、極めて危険になる」(同氏)

そのような危険からどれだけ離れているかすら、今はまだ分からないままだ。オバディア氏が監視し続けている警告サインについて、BuzzFeed Newsから質問してみた。すると、同氏は少し考え、「本当にはっきりとは分からない。残念ながら、すでに多くの警告サインが現実のものとなってしまった」と答えた。