他人の顔写真をポルノ動画に重ねたり、表情を勝手に変えたりするAIによる動画の加工「ディープフェイク」が世界中で問題視されている。

ディープフェイクは、AIによる深層学習「ディープラーニング」と「フェイク」(偽物)を掛け合わせた造語だ。

有名女優から、政治家までが被害に遭っているという。いったい、何が起きているのか。

お手軽な「ディープフェイク」

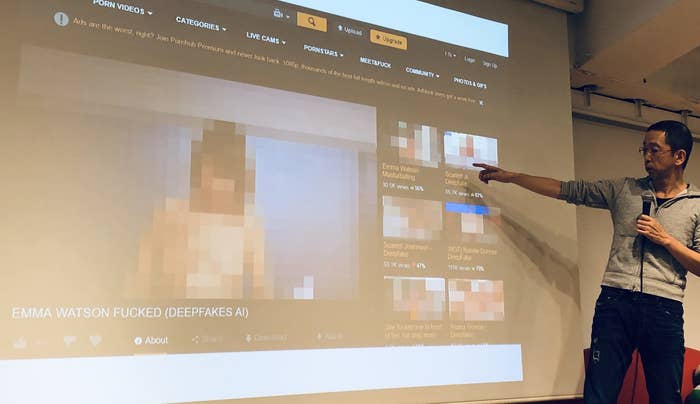

NPO法人「ファクトチェック・イニシアティブ」(FIJ)が12月5日、インターネット上のフェイクをめぐるセミナーを東京都内で開いた。

セミナーでは世界中で問題視されている「ディープフェイク」がひとつのテーマとして取り上げられ、桜美林大学教授の平和博さんがその現状を語った。

平さんによると、そもそも「ディープフェイク」はハンドルネーム「deepfakes」が、2017年の秋口にAIを使った動画を掲示板「Reddit」にアップしていたことが発端とされている。

エマ・ワトソンさんや、メイジー・ウィリアムズさんなどの有名女優の顔だけを、既存のポルノ動画に貼り付けたものを作成。共有していた。

さらに2018年に入ると別のユーザーが「FakeApp」というツールを「Reddit」で公開。こうしたツールを用いたフェイク動画がポルノ動画サイトを通じ、一気に拡散したという。

日本人女優やアイドルも被害に

その後、オープンソースのサービスを経由し、「ディープフェイク」のツール自体もはネット上に広がったという。

オンライン上の有料サービスも出現。1時間あたり2ドルほどの利用料で、「顔を丸ごと交換するのに4時間」で済むようなサイトも存在する。「お手軽に顔交換ができるようになっている」(平さん)のが現状だ。

実際、日本人女優やアイドルが被害に遭っているケースもポルノ動画のサイトでは散見される。BuzzFeed Newsが確認しただけでも10個以上は存在し、多いものでは300万回以上再生されているものもある。

サイバーセキュリティ会社「DeepTrace」の調査(2019年10月)によると、過去7か月で1万4678のディープフェイク動画が確認された。1年で倍増しているといい、その96%がポルノ動画だった。

ディープフェイクに特化した上位4つのポルノサイトでは、数百人の女性有名人のフェイク動画が、計1億3400万回以上も再生されているという。

平さんは「一部では一般人へのリベンジポルノの手法としても使われている。ディープフェイクは、女性に対する人権侵害の問題になっている」と語る。

政治的利用への懸念も

リアルタイムで表情や口の動きを移し替えていくような技術も生まれており、映画などにも活用されている。テキストや音声分野でも同様の技術革新は進んでいる。

とはいえ、こうした技術が前述の通りの被害を生み出すだけではなく、政治的に利用される危険性があると、平さんは指摘する。

「政治家が行っていないことを言ったかのような動画を作成し、拡散させることも可能になっている」

BuzzFeedが2018年4月に映画監督のジョーダン・ピール氏と作成したオバマ前大統領の「ディープフェイク」動画は、そうした危機が近づいていることを伝える大きな契機にもなった。

「クーデター未遂」につながったケースも

しかし、すでに「実際に攻撃も起きている」と平さんは言う。インドでは政権に対して批判的な女性ジャーナリストがフェイクのポルノ動画を拡散された。

アメリカでは、ナンシー・ペロシ下院議員議長の話している動画の再生速度を落とし、酔っ払っているように見せて拡散させるというケースもあった。

また、アフリカのガボンでは「ディープフェイク疑惑」がクーデター未遂につながり、マレーシアでも閣僚の「セックス動画」をめぐる同様の疑惑が政治的混乱を生み出しているという指摘もある。

法規制をめぐる議論もある。アメリカ・バージニア州ではディープフェイクによるリベンジポルノが法改正で禁じられた。

カリフォルニア州でもポルノに関する規制のほか、選挙期間における政治的なディープフェイクの作成などを違法とする法律ができたばかりだ。一方で、こうした法規制が「表現の自由」を脅かすのではないか、という指摘も上がっている。

平さんは「情報の秩序がなくなっているなかで、メディアがもう一度信頼を取り戻し、その秩序を作り直すという取り組みが非常に重要なのではないかと思っています」と語った。